Categoría: Arts and Humanities

ORIGINAL

Impact of artificial intelligence on privacy and discrimination: legal perspectives in Ecuador

Impacto de la inteligencia artificial en la privacidad y la discriminación: perspectivas jurídicas en Ecuador

Salomón Alejandro Montece Giler1 *, María Elena Infante1 *, Brayan Geovanny Haro Erazo1 *, Luis Alfredo Montecé Giler1 *

1Universidad Regional Autónoma de Los Andes. Ecuador.

Citar como: Montece Giler SA, Infante ME, Haro Erazo BG, Montecé Giler LA. Impact of artificial intelligence on privacy and discrimination: legal perspectives in Ecuador. Salud, Ciencia y Tecnología - Serie de Conferencias. 2023;2:1058. https://doi.org/10.56294/sctconf20231058

Enviado: 20-05-2023 Revisado: 22-08-2023 Aceptado: 25-11-2023 Publicado: 26-11-2023

Editor: Dr.

William Castillo-González ![]()

ABSTRACT

Artificial Intelligence (AI) has advanced rapidly, becoming an essential part of modern life and improving efficiency and accuracy across multiple sectors. However, this development poses significant challenges for the protection of human rights, especially in terms of privacy, discrimination, accountability and transparency. As AI becomes integrated into areas such as health, transportation and employment. The objective is to prepare a legal analysis on the protection of human rights in Ecuadorian legal regulations in the era of artificial intelligence. Research methods at the theoretical and empirical level were applied to understand this phenomenon from a social and legal perspective. The results emanating from the semi-structured interview show that the subjects reconstructed the social focus, which is why the creation of specific legislation that regulates the development, implementation and use of artificial intelligence in Ecuador was proposed. It is crucial to review and adapt legal and ethical frameworks to address these challenges. It is concluded that AI has the potential to both improve the quality of life and threaten human rights.

Keywords: Privacy; Discrimination; Legal Frameworks.

RESUMEN

La Inteligencia Artificial (IA) ha avanzado rápidamente, se ha convertido en una parte esencial de la vida moderna y ha mejorado la eficiencia y la precisión en múltiples sectores. Sin embargo, este avance plantea desafíos significativos para la protección de los derechos humanos, especialmente en términos de privacidad, discriminación, responsabilidad y transparencia. A medida que la IA se integra en áreas como la salud, el transporte y el empleo. Se plantea como objetivo, elaborar un análisis jurídico sobre la protección de los derechos humanos en la normativa legal ecuatoriana en la era de la inteligencia artificial. Se aplicaron métodos de investigación del nivel teórico y empírico para comprender este fenómeno desde la perspectiva social y jurídica. Los resultados emanados de la entrevista semiestructurada evidencian que los sujetos reconstruyeron el foco social, por lo que se propuso la creación de una legislación específica que regule el desarrollo, implementación y uso de la inteligencia artificial en Ecuador. Es crucial revisar y adaptar los marcos legales y éticos para abordar estos desafíos. Se concluye que la IA tiene el potencial tanto de mejorar la calidad de vida como de amenazar los derechos humanos.

Palabras clave: Privacidad; Discriminación; Marcos Legales.

INTRODUCCIÓN

En la actualidad, la Inteligencia Artificial (IA) ha experimentado un crecimiento exponencial y se ha convertido en una parte integral de la vida, desde los asistentes virtuales en teléfonos inteligentes hasta los algoritmos que impulsan las recomendaciones en las plataformas de redes sociales (Asamblea Nacional Constituyente, 2008).La IA ha demostrado su capacidad para mejorar la eficiencia, la precisión y la comodidad en diversas áreas de nuestra sociedad.

La inteligencia artificial ha tenido un rápido avance en las últimas décadas, al transformar diversos aspectos de la sociedad y generar tanto oportunidades como desafíos. A medida que la IA se integra en diferentes áreas, desde la atención médica y el transporte hasta el empleo y la toma de decisiones automatizadas, surge la necesidad de examinar su impacto en los derechos humanos. La protección de los derechos fundamentales en la era de la inteligencia artificial se convierte en un tema crucial que requiere una atención especializada y una revisión del marco legal y los mecanismos de regulación existentes.

Sin embargo, a medida que se adentra la era de la IA, también surgen preocupaciones y desafíos en relación con la protección de los derechos humanos. La intersección entre la tecnología de vanguardia y los derechos fundamentales plantea interrogantes cruciales sobre la privacidad, la discriminación, la responsabilidad y la transparencia (Barredo et al., 2021).

La protección de los derechos humanos en la era de la inteligencia artificial implica un equilibrio delicado entre aprovechar los beneficios de la tecnología y garantizar que no se socaven los principios fundamentales que sustentan la sociedad (Pin et al., 2023). Los derechos humanos, como el derecho a la privacidad, la igualdad, la libertad de expresión y el acceso a la justicia, deben ser salvaguardados en este nuevo panorama digital (Grigore, 2022).

Uno de los principales desafíos, es el acceso a una gran cantidad de información sobre los individuos. Esto puede llevar a la intrusión en la privacidad y a la manipulación de decisiones automatizadas que pueden afectar significativamente la vida de las personas. La IA también puede perpetuar y amplificar sesgos y discriminaciones existentes en la sociedad si no se implementan medidas adecuadas para mitigar estos riesgos. En la era de la inteligencia artificial, el tema de la responsabilidad por decisiones erróneas tomadas por máquinas es uno de los desafíos más complejos y debatidos.

La IA tiene el potencial de mejorar la eficiencia, la precisión y la comodidad en diversos ámbitos, pero también plantea importantes interrogantes sobre cómo garantizar que los derechos humanos sean salvaguardados en este nuevo contexto. Tradicionalmente, la responsabilidad por las acciones y decisiones recae en los seres humanos. Sin embargo, la creciente autonomía de los sistemas de inteligencia artificial plantea un dilema sobre cómo asignar la responsabilidad cuando las máquinas son las que toman decisiones. En primer lugar, es importante distinguir entre diferentes tipos de sistemas de IA.

Algunos son sistemas de toma de decisiones autónomos y otros son herramientas utilizadas por humanos para tomar decisiones (Alvarado & Villavicencio, 2024). En el primer caso, donde la máquina toma decisiones sin intervención humana, la responsabilidad podría recaer en los desarrolladores, los propietarios o los operadores del sistema de IA. Estos actores son responsables de garantizar que el sistema esté diseñado y entrenado de manera adecuada, y que cumpla con las regulaciones y estándares éticos establecidos (Rodríguez, 2020).

Debe mencionarse que incluso en los sistemas de IA más autónomos, es difícil argumentar que la máquina tiene una responsabilidad moral o legal completa como la tiene un ser humano. Las máquinas carecen de intencionalidad y no tienen la capacidad de comprender plenamente las consecuencias de sus acciones (Bodero-Solís et al., 2024). Por lo tanto, se argumenta que la responsabilidad última debe recaer en los seres humanos involucrados en el desarrollo y despliegue de la IA. Además, la responsabilidad puede extenderse a lo largo de toda la cadena de desarrollo y uso de la IA.

Esto incluye a los programadores que escriben el código, a los diseñadores que establecen los parámetros y objetivos del sistema, a los recolectores de datos que proporcionan información para entrenar a la IA y a los responsables de su implementación y supervisión. La recopilación y el análisis masivo de datos por parte de los sistemas de IA pueden socavar la privacidad individual y la autonomía, lo que exige un marco regulatorio sólido para proteger estos derechos.

Es importante destacar que la responsabilidad no debe limitarse solo al ámbito legal. La responsabilidad ética también desempeña un papel fundamental en la protección de los derechos de las personas afectadas (Pérez Carrillo et al., 2023). Esto implica evaluar las consecuencias y los impactos potenciales de las decisiones tomadas por las máquinas, así como la implementación de salvaguardias y mecanismos de reparación en caso de daño. En este contexto, la regulación y la gobernanza desempeñan un papel clave en la definición de las responsabilidades. Los marcos legales y éticos deben adaptarse para abordar los desafíos únicos planteados por la IA y establecer estándares claros de responsabilidad, así como mecanismos de supervisión y rendición de cuentas.

La inteligencia artificial corre el riesgo de ser utilizada para ampliar la brecha entre los grupos marginados y los privilegiados, lo que requiere un enfoque atento para garantizar la igualdad y la no discriminación. Estos antecedentes reflejan la diversidad de aspectos y desafíos relacionados con la protección de los derechos humanos en el contexto de la inteligencia artificial, así como la creciente atención y debate en torno a este tema en la comunidad académica, legal y de derechos humanos (Molina & Castro, 2023).

A pesar de estos avances y esfuerzos, subsisten retos significativos en la protección de los derechos humanos en la era de la IA. A través de una revisión de la legislación en vigor, la realización de entrevistas con expertos legales y un análisis de casos relevantes, se aspira a identificar vacíos legales y desafíos prácticos que actualmente obstaculizan la aplicación efectiva de la normativa existente (Jindal & Sharma, 2024).

Más allá de ello, el propósito es presentar recomendaciones específicas y sustentadas que tengan el potencial de fortalecer la protección de los derechos humanos en la era de la IA en el contexto ecuatoriano. Este esfuerzo persigue contribuir a la configuración de un entorno tecnológico que refleje valores éticos sólidos y que redunde en beneficio de toda la sociedad ecuatoriana.

Además, la falta de regulación específica en el ámbito ecuatoriano añade una dimensión adicional a esta problemática. En última instancia, se considera que se debe promover un entorno tecnológico más ético y equitativo en Ecuador, donde los avances en la inteligencia artificial se utilicen en beneficio de la sociedad sin socavar los derechos fundamentales de las personas (Rúales et al., 2023).

Se ha tomado en cuenta un análisis jurídico exhaustivo y contextualizado sobre la protección de los derechos humanos en la normativa legal ecuatoriana en la era de la inteligencia artificial. Para lograr este propósito, se ha examinado la normativa legal existente en Ecuador relacionada con el uso y la implementación de la inteligencia artificial. Se identificaron las disposiciones que tienen implicaciones directas o indirectas en la protección de los derechos humanos. El problema planteado, a partir de estos aspectos es: ¿Cómo contribuir a la protección de los derechos humanos en la normativa legal ecuatoriana en la era de la inteligencia artificial? El objetivo general que se ha establecido es: elaborar un análisis jurídico sobre la protección de los derechos humanos en la normativa legal ecuatoriana en la era de la inteligencia artificial, para contribuir a que estos derechos sean respetados y protegidos adecuadamente.

Objetivos Específicos

1. Identificar y evaluar los vacíos legales y desafíos prácticos en la normativa ecuatoriana relacionada con la inteligencia artificial que afectan la protección de los derechos humanos.

2. Proponer recomendaciones específicas y fundamentadas para fortalecer el marco legal y los mecanismos de regulación en Ecuador y asegurar que los avances en inteligencia artificial se alineen con la protección de los derechos humanos y los valores éticos.

MÉTODO

La modalidad empleada es cualitativa, lo que significa que se estudian fenómenos de manera sistemática y se busca comprender y justificar una situación de carácter constitucional relacionada con la protección de los derechos humanos frente a la IA. Se utilizan entrevistas semiestructuradas para recopilar información de carácter pragmático y reconstruir el foco social. Estas entrevistas permitirán obtener opiniones y percepciones de expertos y actores clave en relación con las políticas de derechos humanos y su vulnerabilidad frente a la IA en Ecuador (Valladolid & Chávez, 2020; Zhang, 2020).

Se aplicó el diseño de investigación no experimental, puesto que es una investigación de impacto social con un estudio de carácter transversal, por ello no existe manipulación de las variables. El alcance de la investigación es Jurídico - descriptivo, ya que se busca especificar las características y propiedades de la aplicación del Artículo 16 de la Constitución de la República del Ecuador en el contexto de la IA y los derechos humanos. Se analizó cómo se aplican y fortalecen los derechos humanos en esta era tecnológica.

Se han usado métodos de investigación del nivel teórico, como el analítico-sintético, que permite descomponer el todo en sus partes y resumir los aspectos más relevantes de un fenómeno y el inductivo-deductivo, que se basa en el reconocimiento de que la inducción es la forma de razonamiento por medio de la cual se pasa del análisis de casos particulares a lo general (Falcón & Serpa, 2021)

Se ha utilizado, además, el método exegético-jurídico, el cual permite la interpretación jurídica de las normas constitucionales. Este método ha posibilitado estudiar el marco legal referente al objeto. Se ha empleado, para la recolección de datos, la entrevista, se colocó al investigador en contacto personal con los sujetos tipo. En esta investigación se aplicó este método para llegar a conclusiones sobre la vulneración de los derechos humanos ante la Inteligencia Artificial.

Para la recolección de información fue necesario elaborar como instrumento una guía de entrevista dirigida a profesionales del derecho y a administradores de justicia. En cuanto a la población de la investigación, se señala que está compuesta por profesionales y expertos en derecho constitucional y derechos humanos en Ecuador.

La muestra se selecciona de manera intencional y está conformada por 12 informantes, a los cuales se les realiza una entrevista semi-estructurada: dos Abogados constitucionales de la ciudad de Riobamba, dos exasesores jurídicos del municipio del Cantón Guano, dos profesores universitarios de derecho constitucional de la Universidad Regional Autónoma de los Andes, sede Riobamba, dos jueces especializados en derecho constitucional de la Unidad Judicial de la ciudad de Riobamba y dos periodistas de La Prensa-Riobamba.

RESULTADOS

Se implementó una encuesta, con preguntas centradas en el tema. Los resultados mostraron una alta confiabilidad. Se procede a aplicar la técnica antes expuesta, de la siguiente manera:

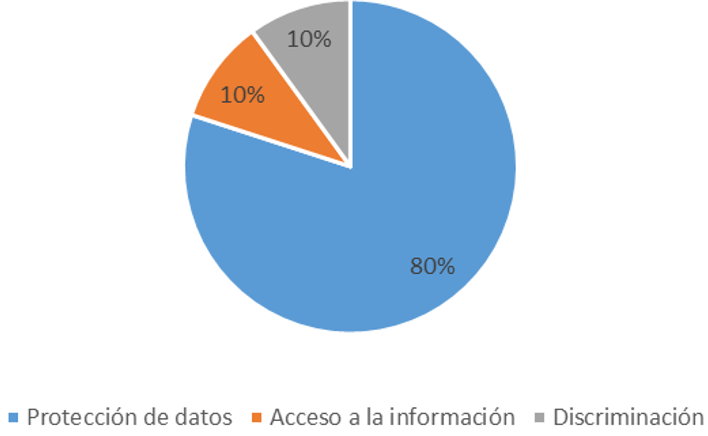

Pregunta 1. ¿Qué situaciones se evidencian en la vulneración de los derechos humanos?

Figura 1. Vulneración de los derechos humanos

En el análisis de los datos obtenidos, debe mencionarse que los entrevistados consideran que en el contexto de la inteligencia artificial se produjeron situaciones que evidenciaron la vulneración de los derechos humanos. El 80 % considera en especial los relacionados con la protección de datos, el 10 % de los encuestados considera que son el acceso a la información y la discriminación.

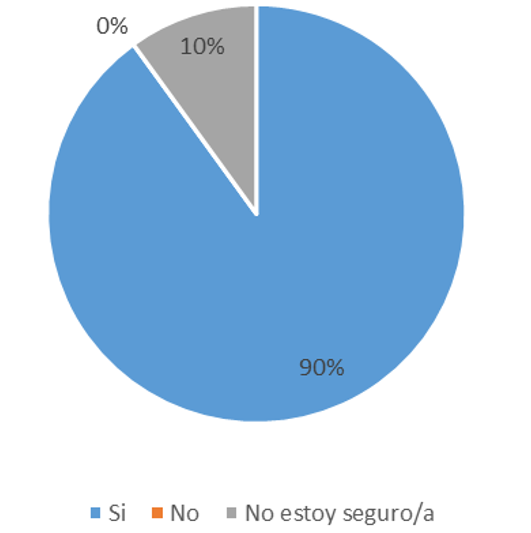

Pregunta 2. ¿Considera que la inteligencia artificial presenta un riesgo significativo para la protección de los derechos humanos?

Figura 2. Riesgo de la Inteligencia Artificial

Al indagar sobre los riesgos de la inteligencia artificial en los derechos humanos en Ecuador, los informantes reconocen su vulneración en un contexto tan complejo para el cual no se estaba preparado, con un resultado del 90 %, mientras que el 10 % no está seguro. El análisis de la información alcanzada conlleva a determinar la categoría: la inteligencia artificial provocó la vulneración de derechos humanos.

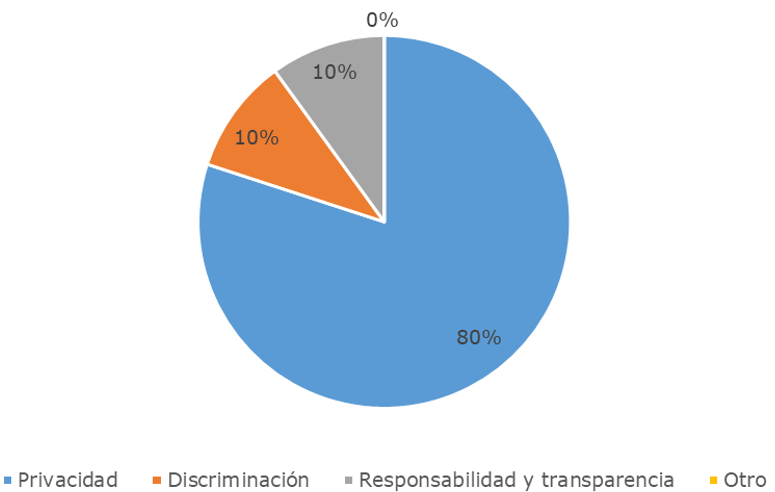

Pregunta 3. En su opinión, ¿cuál es el principal desafío que plantea la IA en relación con los derechos humanos?

Figura 3. Principal desafío que plantea la IA

Los encuestados evaluaron en un 80 % a la privacidad como el principal desafío y en un 10 % la discriminación y la responsabilidad y transparencia. En lo que respecta a la privacidad, la IA a menudo implica la recopilación y el análisis de datos personales para tomar decisiones, lo que plantea cuestiones sobre quién tiene acceso a esos datos y cómo se utilizan. Se menciona que se ha invadido la privacidad debido a la recopilación de datos por parte de sistemas de IA, como anuncios dirigidos o la exposición de información personal.

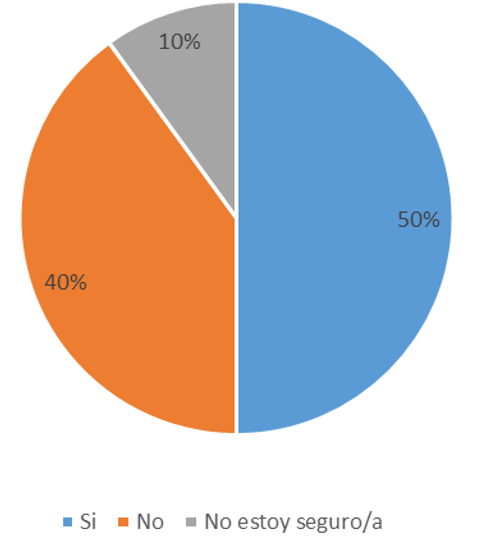

Pregunta 4. ¿Cree que la legislación actual en Ecuador es suficiente para proteger los derechos humanos en el contexto de la inteligencia artificial?

Figura 4. Suficiencia de la legislación actual

Solo el 50 % refiere que la legislación actual de Ecuador es suficiente para proteger los derechos humanos. El 40 % no está de acuerdo, pues cree necesario discutir la claridad que deben contener las normas. Bajo este contexto las normas claras y comprensibles, hacen relación y tienen que ver con la técnica legislativa.

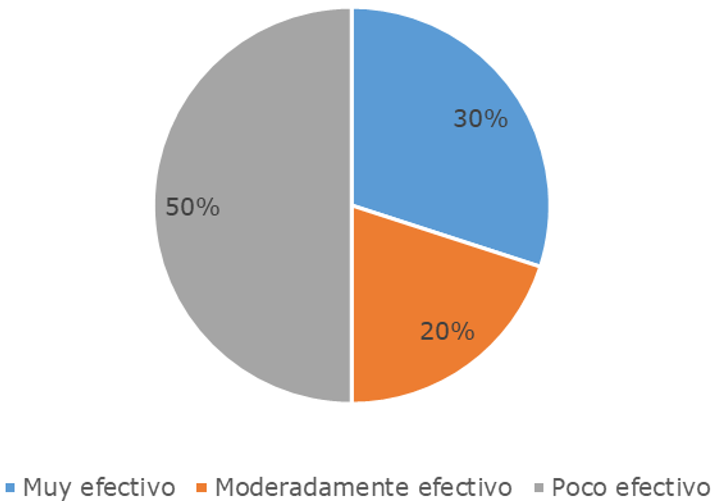

Pregunta 5. ¿Qué tan efectivo considera que es el marco regulatorio actual para mitigar los riesgos asociados con la IA en Ecuador?

Figura 5. Eficiencia del marco regulatorio

El 50 % de los encuestados refiere que el marco regulatorio es poco efectivo, el 30 % dice que es muy efectivo y el 20 % que es moderadamente efectivo. Esta evaluación legal es fundamental para garantizar que las políticas y regulaciones se adapten a las necesidades cambiantes de la sociedad y que se protejan de manera efectiva los derechos y las libertades individuales en el uso de la IA en Ecuador. Además, puede contribuir al desarrollo de marcos legales más sólidos y adecuados que promuevan un entorno ético y equitativo en la aplicación de la inteligencia artificial en el país.

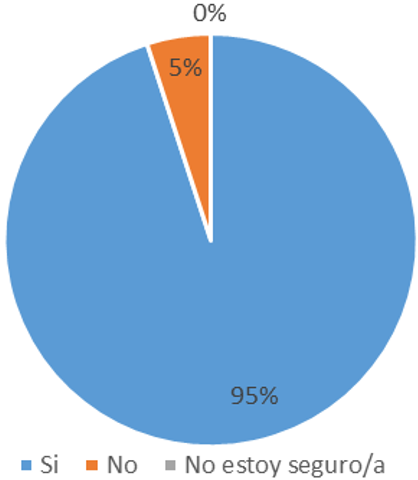

Pregunta 6. ¿Ha identificado vacíos legales específicos en la normativa ecuatoriana que deban ser abordados para proteger mejor los derechos humanos frente a la IA?

Figura 6. Vacíos legales en la normativa ecuatoriana

El 95 % de los encuestados refiere que Sí se han identificado vacíos legales, pues entienden que existe falta de regulación sobre el uso de datos personales en sistemas de IA. Dada la ausencia de leyes específicas en el Ecuador que regulen el desarrollo responsable de la IA, se proponen algunos lineamientos éticos preliminares contextualizados a la realidad local, que contemplan principios para evitar discriminación algorítmica, proteger la privacidad de datos, fomentar la transparencia y rendición de cuentas.

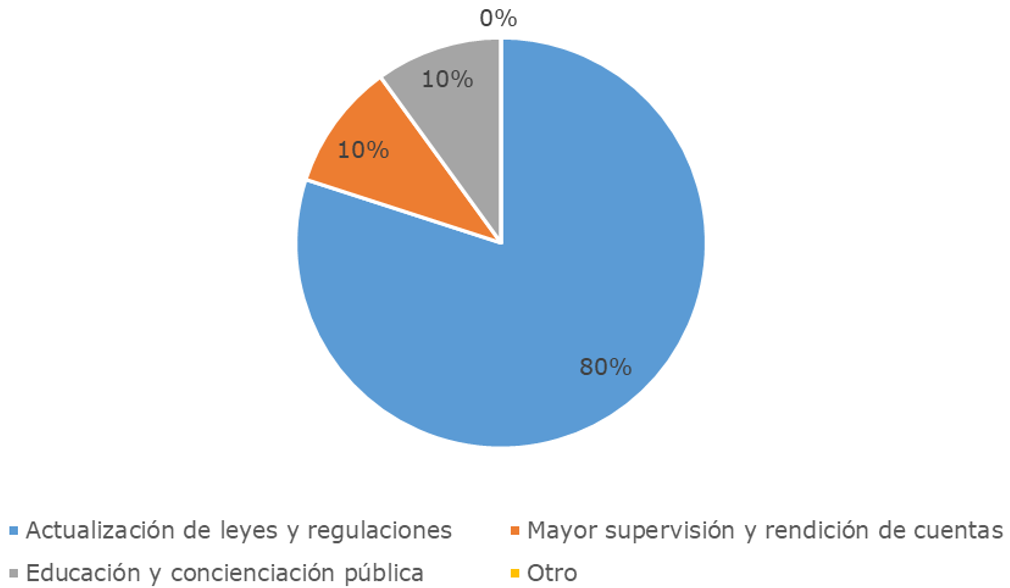

Pregunta 7. ¿Qué medidas cree que son necesarias para fortalecer la protección de los derechos humanos en el contexto de la IA en Ecuador?

Figura 7. Medidas Necesarias

El 80 % considera que se deben actualizar las leyes y Regulaciones. Se aborda la inexistencia o insuficiencia de regulaciones robustas sobre la protección de datos personales en el contexto de la IA. Las leyes actuales pueden no abordar adecuadamente cómo deben ser gestionados y protegidos los datos recopilados y procesados por sistemas de IA.

Pregunta 8. ¿Considera que los desarrolladores y operadores de sistemas de IA deben ser los principales responsables de las decisiones tomadas por las máquinas?

El 95 % de los encuestados refieren que los desarrolladores tienen la mayor responsabilidad por las decisiones tomadas por las máquinas. Esta debe ser compartida entre los desarrolladores, los operadores, los proveedores de datos y las autoridades reguladoras. Si bien los desarrolladores tienen una responsabilidad crucial en el diseño, pruebas y mantenimiento de los sistemas de IA, otros actores también deben desempeñar roles importantes para garantizar un uso seguro, ético y responsable de la inteligencia artificial.

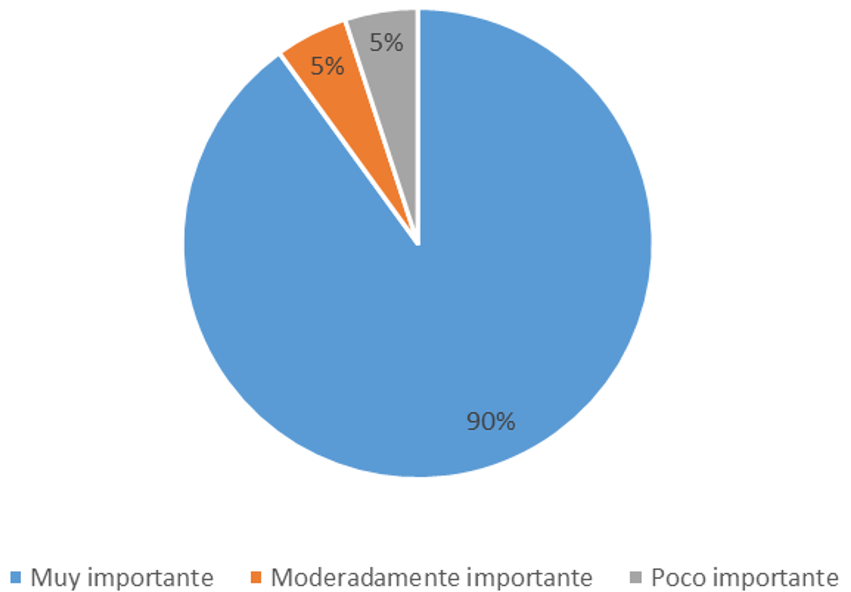

Pregunta 9. ¿Qué importancia le asigna a la responsabilidad ética en el desarrollo y despliegue de la IA?

Figura 8. Importancia de la responsabilidad ética

Se tiene que el 90 % considera muy importante, mientras que el 5 % lo tienen poco importante y moderadamente importante. La responsabilidad ética en el desarrollo y despliegue de la inteligencia artificial es de suma importancia, ya que garantiza que los avances tecnológicos se alineen con los principios fundamentales de derechos humanos, equidad y justicia. Al integrar consideraciones éticas en cada etapa del ciclo de vida de los sistemas de IA, desde el diseño y la programación hasta la implementación y el mantenimiento, se promueve la transparencia, se minimizan los riesgos de sesgos y discriminación, y se protege la privacidad y la dignidad de las personas.

Pregunta 10. ¿Está de acuerdo con que se establezcan estándares internacionales para regular el uso de la IA y proteger los derechos humanos?

El 100 % está totalmente de acuerdo. La creación de estándares globales puede proporcionar un marco uniforme y coherente que guíe el desarrollo y la implementación de tecnologías de IA de manera ética y responsable. Estos estándares ayudarían a asegurar que todos los países, independientemente de su nivel de desarrollo tecnológico, adopten prácticas que respeten y promuevan los derechos humanos, eviten la discriminación y protejan la privacidad de los individuos. Además, los estándares internacionales pueden facilitar la cooperación transfronteriza y el intercambio de mejores prácticas, contribuyendo a un uso más seguro y beneficioso de la IA a nivel global.

La discusión abarca los resultados del análisis documental de las fuentes consultadas y de la entrevista, semi estructurada, realizada a los informantes clave, seleccionados a parte de su conocimiento sobre el objeto. El análisis documental ha permitido destacar cómo a menudo los Estados y las empresas se han precipitado a incorporar los programas informáticos de IA sin ejercer la diligencia debida. Ha habido muchos casos de personas que han sido injustamente tratadas a causa de la IA, ya sea porque se les ha denegado prestaciones del seguro social debido a la aplicación de instrumentos deficientes de IA o porque han sido arrestadas como consecuencia de errores en los sistemas de reconocimiento facial.

Otro aspecto importante de discutir es la claridad que deben contener las normas, pues si en verdad la disposición legal del Artículo 16 de la Constitución de la República del Ecuador(Asamblea Nacional Constituyente, 2008), de manera expresa pareciere estar claro, ya dentro de su aplicación la grave crisis política o conmoción interna, ante la vulneración de los mismos por parte de la Inteligencia Artificial, bajo este contexto las normas claras y comprensibles, hacen relación y tienen que ver con la técnica legislativa, criterio que coincide con los resultados obtenidos.

Se necesita trabajar para que las herramientas tecnológicas no sean las nuevas causantes de más desigualdad entre quienes menos tienen en el mundo. La paradoja está presente y la oportunidad para tomar acciones es parte de la discusión pública en todo el mundo. Se cuenta con evidencia respecto al rumbo que podría tomar la inteligencia artificial si no es bien gestionada y los ejemplos sobran.

A partir de la Entrevista se colige que existe la vulneración de los Derechos Humanos ante la era de la Inteligencia artificial (IA), se plantea como un tema crucial en la actualidad. A medida que la IA se integra cada vez más a la vida, es esencial comprender los posibles impactos en los derechos fundamentales. En la actualidad existe preocupación sobre la vulneración de los Derechos Humanos, como la privacidad, la no discriminación y la igualdad de acceso, ante el desarrollo de la inteligencia artificial.

En lo que respecta a la privacidad, la IA a menudo implica la recopilación y el análisis de datos personales para tomar decisiones, lo que plantea cuestiones sobre quién tiene acceso a esos datos y cómo se utilizan. Se menciona que se ha invadido la privacidad debido a la recopilación de datos por parte de sistemas de IA, como anuncios dirigidos o la exposición de información personal.

En la actualidad, la inteligencia artificial es una parte integral de la vida, desde asistentes virtuales en nuestros teléfonos hasta sistemas de toma de decisiones en sectores como la medicina y las finanzas. Sin embargo, muchas personas pueden no comprender completamente cómo funciona la IA, cómo se utilizan sus datos o cuáles son los posibles impactos en sus derechos fundamentales. La educación en esta área puede ayudar a cerrar esta brecha de conocimiento. Al proporcionar información sobre los conceptos básicos de la inteligencia artificial, sus aplicaciones y sus desafíos, las personas pueden tomar decisiones más informadas sobre su uso y desarrollo.

La revisión de las disposiciones legales pertinentes a la IA en el contexto ecuatoriano debe considerarse detenidamente. Estas leyes abordan cuestiones como la privacidad de los datos, la no discriminación, la igualdad de acceso y otros derechos humanos relevantes. Esta evaluación legal es fundamental para garantizar que las políticas y regulaciones se adapten a las necesidades cambiantes de la sociedad y que se protejan de manera efectiva los derechos y las libertades individuales en el uso de la IA en Ecuador. Además, puede contribuir al desarrollo de marcos legales más sólidos y adecuados que promuevan un entorno ético y equitativo en la aplicación de la inteligencia artificial en el país.

Recomendaciones específicas para fortalecer la protección de los derechos humanos en la era de la inteligencia artificial en Ecuador:

1. Implementar una revisión exhaustiva de la legislación actual para identificar vacíos y ambigüedades en relación con la inteligencia artificial. Esto incluye la promulgación de leyes específicas que regulen el uso de IA, protejan la privacidad de los datos y mitiguen la discriminación algorítmica.

2. Establecer directrices claras y obligatorias sobre la responsabilidad ética en el diseño, desarrollo y despliegue de sistemas de inteligencia artificial. Esto debe incluir la incorporación de principios éticos en los programas educativos y la formación continua para los profesionales involucrados en proyectos de IA.

3. Establecer un organismo regulador independiente y capacitado para supervisar el cumplimiento de las normativas sobre IA. Este organismo debería tener la capacidad de investigar denuncias, aplicar sanciones adecuadas y garantizar la transparencia en el uso de tecnologías de IA por parte de entidades públicas y privadas.

4. Incentivar la investigación y el desarrollo de IA ética y responsable en Ecuador mediante la colaboración entre instituciones académicas, empresas tecnológicas y organizaciones de la sociedad civil. Esto puede lograrse mediante subvenciones, premios y programas de innovación que prioricen la seguridad, la equidad y la protección de los derechos humanos.

5. Desarrollar campañas educativas dirigidas al público en general sobre los beneficios y los riesgos de la inteligencia artificial. Esto incluye aumentar la conciencia sobre cómo proteger los derechos individuales frente al uso de tecnologías avanzadas, fomentando un uso responsable y ético de la IA en la sociedad ecuatoriana.

CONCLUSIONES

Los derechos humanos son inherentes a toda persona, promulgan la necesaria igualdad entre los seres humanos como base de su propia existencia. Su reconocimiento y respeto permiten que el individuo desarrolle una vida digna como le corresponde, se consagran en la Declaración Universal de Derechos Humanos, a partir de la cual se exige su respeto en las diferentes naciones. Los resultados obtenidos, mediante los métodos e instrumentos utilizados en la realización del diagnóstico sobre el estado actual del objeto, evidencian la vulneración de los derechos por parte de la inteligencia artificial.

La responsabilidad ética en el desarrollo, despliegue y uso de sistemas de IA es fundamental para garantizar que estos avances tecnológicos beneficien a la sociedad ecuatoriana sin comprometer los derechos humanos fundamentales. Esto implica establecer estándares éticos claros y mecanismos efectivos de supervisión y rendición de cuentas.

Existe una clara necesidad de actualizar y fortalecer el marco normativo ecuatoriano para abordar de manera efectiva los desafíos éticos y legales que plantea la inteligencia artificial. Esto incluye la protección de la privacidad, la mitigación de la discriminación algorítmica y la definición clara de responsabilidades en decisiones automatizadas.

Abordar los desafíos de la IA y los derechos humanos requiere una colaboración estrecha entre el gobierno, la academia, la sociedad civil y el sector privado. Es crucial crear un diálogo inclusivo y participativo para desarrollar políticas públicas y estrategias regulatorias que sean equitativas, transparentes y adaptadas a las realidades locales de Ecuador.

REFERENCIAS BIBLIOGRÁFICAS

1. Alvarado, H., & Villavicencio, O. (2024). Regulación del Manejo de la Inteligencia Artificial, Consecuencias y Daños a la Sociedad por su Mal Uso. Ciencia Latina Revista Científica Multidisciplinar, 8(1), 1966-1978. https://www.researchgate.net/publication/378146987_Regulacion_del_Manejo_de_la_Inteligencia_Artificial_Consecuencias_y_Danos_a_la_Sociedad_por_su_Mal_Uso/citation/download?_tp=eyJjb250ZXh0Ijp7ImZpcnN0UGFnZSI6InB1YmxpY2F0aW9uIiwicGFnZSI6InB1YmxpY2F0aW9uIn19

2. Barredo, D., de la Garza Montemayor, D. J., Torres-Toukoumidis, Á., & López-López, P. C. (2021). Inteligencia artificial, comunicación y democracia en América Latina: una revisión de los casos de Colombia, Ecuador y México. Profesional de la Informacion, 30(6), 1-17. https://pure.urosario.edu.co/es/publications/inteligencia-artificial-comunicación-y-democracia-en-américa-lati

3. Bodero-Solís, M. K., Robles-Zambrano, G. K., & del Rocío García-Sánchez, G. (2024). Inteligencia artificial en la administración de justicia en el Ecuador [Artificial intelligence in the administration of justice in Ecuador]. Revista Multidisciplinaria Perspectivas Investigativas, 4(Derecho), 26-31. https://rperspectivasinvestigativas.org/index.php/multidiscipinaria/article/view/128

4. Ecuador, Asamblea Nacional Constituyente. (2008). Constitución de la República del Ecuador. Registro Oficial 449. Gobierno del Ecuador. http://www.oas.org/juridico/pdfs/mesicic4_ecu_const.pdf

5. Falcón, A. L., & Serpa, G. R. (2021). Acerca de los métodos teóricos y empíricos de investigación: significación para la investigación educativa. Revista Conrado, 17(S3), 22-31. https://conrado.ucf.edu.cu/index.php/conrado/article/view/2133

6. Grigore, A. E. (2022). Derechos humanos e inteligencia artificial. IUS ET SCIENTIA, 8 (1), 165-175. https://revistascientificas.us.es/index.php/ies/article/view/19991/18602

7. Jindal, A., & Sharma, A. (2024). THE IMPACT OF ARTIFICIAL INTELLIGENCE ON SOCIETY. https://doi.org/10.13140/RG.2.2.18522.96968

8. Molina, K. G. A., & Castro, C. L. A. (2023). La inteligencia artificial y la limitación al derecho a la privacidad cibernética, en estudiantes de Jurisprudencia, Cuenca-Ecuador 2022. LATAM Revista Latinoamericana de Ciencias Sociales y Humanidades, 4(1), 657-666. https://latam.redilat.org/index.php/lt/article/view/284

9. Pérez Carrillo, J. R., Gallegos Rodríguez, K. A., & Mieles Trujillo, P. S. (2023). Derecho a la intimidad vs. inteligencia artificial: Un análisis desde la perspectiva jurídica ecuatoriana [Trabajo de investigación de Artículo Científico previo a la obtención del título de Abogado, Universidad San Gregorio de Portoviejo]. http://repositorio.sangregorio.edu.ec:8080/handle/123456789/3286

10. Pin, K. R. M., Ponce, A. A. C., & Cevallos, R. X. G. (2023). IMPLICACIONES DE LA INTELIGENCIA ARTIFICIAL EN LA EDUCACIÓN SUPERIOR. REFCalE: Revista Electrónica Formación y Calidad Educativa. ISSN 1390-9010, 11(2), 15-27.

11. Rodríguez, A. L. T. (2020). Inteligencia artificial, responsabilidad y compromiso cívico y democrático. Revista Iberoamericana de Ciencia, Tecnología y Sociedad-CTS, 15(44). https://ojs.revistacts.net/index.php/CTS/article/view/166

12. Rúales, A. L. C., Zambrano, G. R., & Basurto, I. J. D. (2023). La inteligencia artificial y el derecho a la intimidad-privacidad. Iustitia Socialis: Revista Arbitrada de Ciencias Jurídicas y Criminalísticas, 8(Extra 0, 8), 84-93. https://dialnet.unirioja.es/servlet/articulo?codigo=9005138

13. Valladolid, M. N., & Chávez, L. M. N. (2020). El enfoque cualitativo en la investigación jurídica, proyecto de investigación cualitativa y seminario de tesis. Vox juris, 38(2), 69-90. https://dialnet.unirioja.es/servlet/articulo?codigo=7628480

14. Zhang, Z. (2020). Técnicas de investigación cualitativa como instrumentos de enseñanza-aprendizaje de la competencia comunicativa e intercultural de estudiantes sinohablantes de ELE. marcoELE. Revista de Didáctica Español Lengua Extranjera, 30(Junio), 1-24. https://www.redalyc.org/journal/921/92161847008/92161847008.pdf

FINANCIACIÓN

Ninguna.

CONFLICTO DE INTERÉS

Ninguno.

CONTRIBUCIÓN DE AUTORÍA

Conceptualización: Salomón Alejandro Montece Giler, María Elena Infante, Brayan Geovanny Haro Erazo, Luis Alfredo Montecé Giler.

Curación de datos: Salomón Alejandro Montece Giler, María Elena Infante, Brayan Geovanny Haro Erazo, Luis Alfredo Montecé Giler.

Investigación: Salomón Alejandro Montece Giler, María Elena Infante, Brayan Geovanny Haro Erazo, Luis Alfredo Montecé Giler.

Administración del proyecto: Salomón Alejandro Montece Giler, María Elena Infante, Brayan Geovanny Haro Erazo, Luis Alfredo Montecé Giler.

Recursos: Salomón Alejandro Montece Giler, María Elena Infante, Brayan Geovanny Haro Erazo, Luis Alfredo Montecé Giler.

Supervisión: Salomón Alejandro Montece Giler, María Elena Infante, Brayan Geovanny Haro Erazo, Luis Alfredo Montecé Giler.

Redacción – borrador original: Salomón Alejandro Montece Giler, María Elena Infante, Brayan Geovanny Haro Erazo, Luis Alfredo Montecé Giler.